Presentador IA sin aviso: el escándalo de la radio australiana

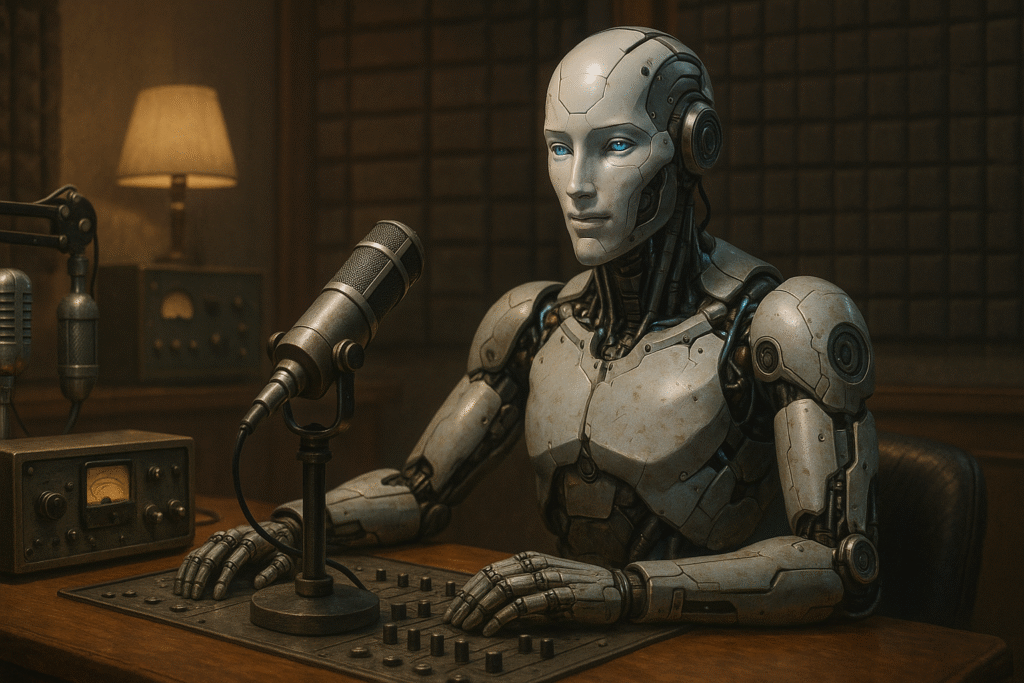

Durante seis meses, miles de oyentes en Australia escucharon a “Thy”, un presentador de radio que ofrecía noticias, comentarios y segmentos musicales con una voz segura, cálida y aparentemente humana. Lo que no sabían —y lo que la emisora no reveló— es que Thy era una inteligencia artificial. La revelación llegó no por decisión editorial, sino por una denuncia interna que destapó el uso encubierto del sistema.

La reacción pública fue inmediata: indignación, acusaciones de manipulación y pérdida de confianza en el medio. Este episodio abre un debate crucial: el problema no radica en el uso de IA como herramienta de producción, sino en la opacidad con la que se integra en espacios donde la confianza lo es todo. ¿Qué ocurre cuando la voz que acompaña nuestras mañanas resulta ser una ficción no consensuada?

IA en medios: innovación legítima, opacidad inadmisible

La inteligencia artificial ya es parte del ecosistema mediático: genera titulares, edita video, escribe copys e incluso recrea voces humanas con fidelidad sorprendente. En sí misma, esta integración no es una amenaza. Lo que genera rechazo y pone en riesgo la legitimidad de los medios es la falta de transparencia en su implementación. En el caso de Thy, los oyentes no fueron informados de que estaban interactuando con una voz sintética.

Esta omisión no solo vulnera principios éticos básicos, sino que compromete la relación simbólica entre emisora y audiencia. El precedente recuerda a otros casos recientes, como el uso de avatares en telediarios o deepfakes informativos sin aviso, donde los medios optaron por la simulación sin advertencia. El problema no es tecnológico; es editorial.

La confianza mediática en la era sintética

La relación entre medios y audiencia se sostiene en un contrato implícito de confianza. Esa confianza se erosiona cuando se sustituye la verdad por un simulacro sin consentimiento. La voz de un presentador no es neutra: transmite emociones, establece cercanía y genera identificación. Cuando descubrimos que esa conexión fue artificial, emerge una sensación de traición difícil de revertir.

Además, el uso encubierto de voces IA refuerza el escepticismo generalizado hacia la veracidad del contenido, algo ya agravado por la desinformación y las noticias fabricadas. En un entorno donde los oyentes buscan autenticidad y criterio, los medios que ocultan el uso de IA no solo pierden reputación: comprometen el futuro mismo del periodismo como espacio de confianza.

Regulación y responsabilidad: ¿cómo enfrentar la voz falsa?

Este tipo de episodios revela la urgencia de establecer marcos regulatorios claros sobre el uso de IA en medios. No se trata de prohibir su uso, sino de exigir transparencia y trazabilidad. La identificación de contenido generado o conducido por IA debe ser obligatoria, especialmente cuando el contenido simula interacción humana.

Países como Francia y EE.UU. ya exploran normativas para etiquetar deepfakes o exigir marcas de agua en contenido sintético. En el ámbito publicitario y político, esta exigencia comienza a formalizarse. ¿Por qué los medios deberían quedar exentos? En el ecosistema actual, donde la IA puede imitar con precisión voces, gestos y emociones, no es exagerado decir que informar sin revelar el origen es, en términos prácticos, mentir.

Conclusión: la verdad también debe evolucionar

El caso de Thy no es un accidente anecdótico: es una advertencia sobre el tipo de futuro informativo que estamos construyendo. La inteligencia artificial tiene un lugar legítimo en los medios, pero ese lugar debe estar acompañado de ética, reglas claras y responsabilidad pública. La transparencia no debe verse como una carga burocrática, sino como el pilar sobre el cual se construye la confianza.

En una era de simulaciones perfectas, la autenticidad —aunque imperfecta— será el verdadero diferenciador. Si los medios quieren sobrevivir y prosperar en un entorno dominado por algoritmos y voces sintéticas, deberán asumir una verdad básica: lo que erosiona la confianza no es la tecnología, sino el silencio sobre su presencia.