OpenAI y su red social: ¿IA entrenada o usuarios observados?

Las plataformas sociales nacieron como entornos de conexión humana, pero se han convertido en sistemas de recolección masiva de información. Durante años, empresas como Meta, TikTok o X han perfeccionado la extracción de datos personales con fines publicitarios y de modelado de comportamiento.

Lo que distingue el movimiento reciente de OpenAI no es la actividad en sí, sino su claridad de propósito: crear un entorno que sirva directamente al entrenamiento de modelos de inteligencia artificial. No hay ficción social como envoltorio ni promesa de comunidad: lo que se perfila es un entorno donde la interacción humana es el medio, pero no el fin. Este giro explícito convierte a OpenAI en pionera de una nueva generación de plataformas donde los datos no solo se usan, sino que se diseñan para ser útiles.

Visual first: imágenes virales, datos digeribles para la IA

En esta nueva arquitectura digital, la imagen ocupa el centro del escenario. OpenAI ya ha demostrado con su generador de imágenes la capacidad de viralizar contenido visual a escala, pero su interés va más allá del impacto cultural. Las imágenes son inputs altamente estructurados y predecibles para los modelos de IA: menos ambiguas que el texto, más ricas que un emoji.

En un contexto donde el lenguaje natural tiende al caos y a la ambigüedad, el contenido visual ofrece patrones claros, etiquetables y entrenables. Así, el “social feed” ya no se construye para el usuario, sino para el sistema que lo analiza. Las imágenes no solo comunican: son bloques de datos que alimentan la máquina.

Privacidad como peaje: si usas IA, cedes tus datos

A medida que las herramientas de IA se democratizan, el acceso a ellas se convierte en un intercambio. Disfrutar de funcionalidades avanzadas—generadores de imágenes, asistentes inteligentes, herramientas de productividad—exige abrir las puertas de nuestra privacidad. Gustos, hábitos, edad, ubicación, o el correo electrónico se convierten en moneda.

Las normativas de protección de datos, especialmente en Europa, han intentado ofrecer un marco legal que limite estos abusos. Pero la realidad es otra: los modelos necesitan volumen y calidad de datos para mejorar, y las opciones reales del usuario para no participar son escasas. La privacidad, en este nuevo orden, no desaparece, pero se diluye: ya no es un derecho pleno, sino una cláusula de servicio.

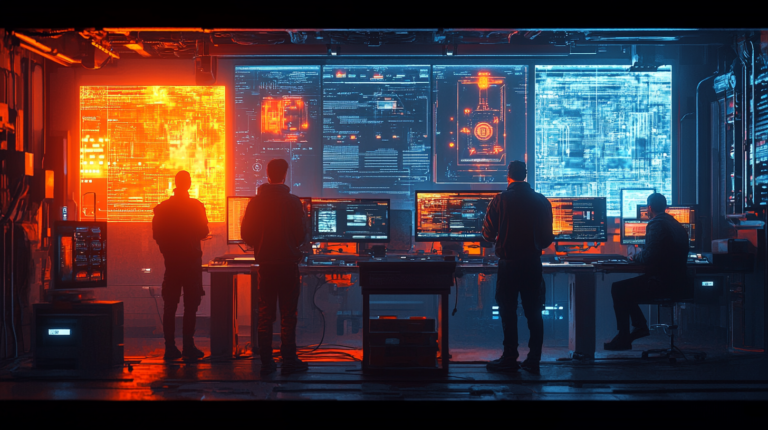

Integración total del dato: OpenAI y la propiedad del ciclo completo

A diferencia de otros gigantes tecnológicos que compran datos a terceros, se nutren de actividad externa o dependen de acuerdos con otras plataformas, OpenAI persigue una estrategia de integración vertical total. Quiere ser el origen, el canal y el destino del dato. Este modelo permite reducir dependencias externas, acelerar el ciclo de entrenamiento y, sobre todo, mejorar la calidad de los datos mediante control directo sobre su contexto y formato.

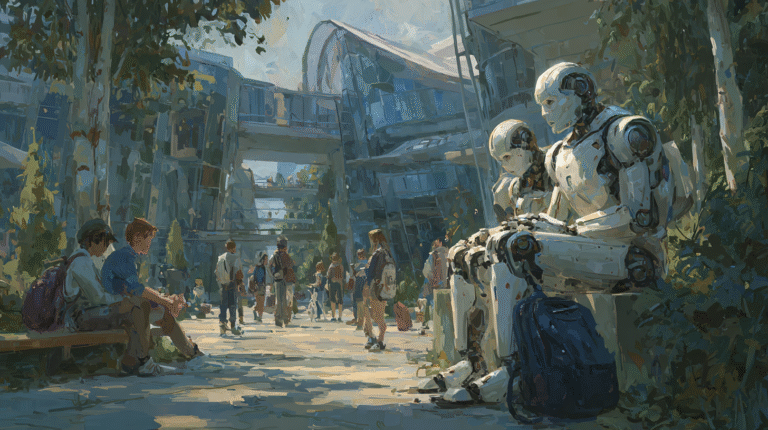

La idea no es nueva en la industria—Tesla ha hecho lo propio con su ecosistema cerrado de datos de conducción—, pero en el ámbito social representa un cambio de paradigma: la red no se diseña para ser popular, sino útil. Y su verdadera usuaria no es la persona, sino la IA.

¿Qué pintamos los humanos en las redes sociales del futuro?

La cuestión ya no es si queremos participar en estas plataformas, sino qué papel desempeñamos realmente. Cuando Meta anuncia que sus IAs generarán respuestas automáticas en Instagram o WhatsApp, y cuando OpenAI plantea una red que podría estar optimizada para modelos, no para personas, surge una pregunta inevitable: ¿seguimos siendo usuarios o solo sensores?

La frontera entre interacción humana y generación de señales para máquinas se vuelve difusa. En este escenario, nuestra presencia ya no es deseada por lo que somos, sino por lo que producimos sin querer: patrones, reacciones, etiquetas emocionales. El vértigo no proviene solo de la tecnología, sino de la posibilidad de que el diálogo digital deje de tenernos como interlocutores.