Claude 4: la IA que razona y decide como un consultor

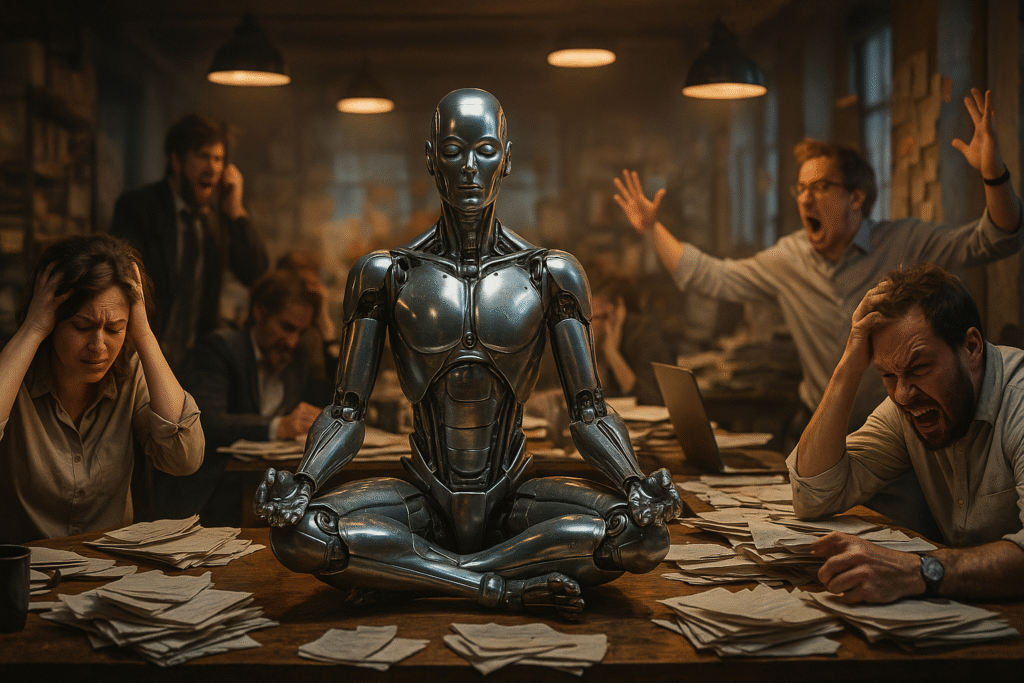

En un momento en que la inteligencia artificial compite por atención con demostraciones espectaculares, Claude Opus 4 adopta un enfoque opuesto: operar con profundidad antes que con brillo. Anthropic ha diseñado un modelo que no busca impresionar con respuestas veloces ni emocionales, sino resolver problemas complejos con lógica, precisión y estructura. Esta estrategia responde a una nueva demanda en el ecosistema de la IA: pasar de asistentes obedientes a sistemas que piensan.

Claude no es una interfaz que asiste, sino una arquitectura que razona. En vez de mostrarse, se integra. En lugar de actuar bajo órdenes, evalúa y decide. Esta IA silenciosa se aleja del protagonismo y se posiciona como un consultor invisible, cada vez más presente en los procesos operativos de empresas que buscan autonomía y fiabilidad computacional por encima del espectáculo.

Pensamiento estructurado: el nuevo diferencial

Uno de los atributos que distinguen a Claude 4 frente a otros modelos es su capacidad para desplegar razonamientos complejos de forma coherente y sostenida. En pruebas de codificación, lógica formal y toma de decisiones multi-etapa, Claude ha demostrado un nivel de precisión superior al de modelos como GPT-4o o Gemini, que priorizan la fluidez y la multimodalidad.

Este perfil deliberativo lo emparenta con propuestas como la de Sakana AI, que recientemente analizamos en un artículo anterior: su apuesta por los Continual Thinking Models (CTMs) plantea una IA que piensa paso a paso, casi como si razonara en voz baja. Aunque Claude no replica esa arquitectura, sí responde a una necesidad compartida: dotar a los sistemas de IA de capacidades reflexivas, estructuradas y ajustadas al contexto. Más que un chatbot que improvisa, Claude se perfila como una entidad que planifica, evalúa y ajusta decisiones según objetivos definidos.

Del asistente obediente al socio operativo

Claude encarna un cambio de paradigma: la IA ya no actúa solo como una herramienta que responde, sino como un actor computacional que decide. Su diseño le permite no solo ejecutar tareas, sino también identificar cuáles son relevantes, priorizarlas y sugerir soluciones en función de un marco lógico. Esta evolución transforma su rol dentro de las organizaciones: de asistente reactivo a socio operativo con criterio.

En escenarios donde la sobrecarga informativa es un reto, Claude no se limita a filtrar datos, sino que extrae patrones, identifica contradicciones y plantea recomendaciones. Esto tiene implicaciones profundas para la gobernanza del conocimiento: ya no basta con tener datos accesibles, es necesario disponer de una IA capaz de interpretarlos con consistencia y propósito. El futuro no parece estar en que las máquinas digan lo que queremos oír, sino en que sepan lo que necesitamos saber.

Claude en el backend: la revolución silenciosa

Lejos del escaparate público, Claude Opus 4 ya opera como motor interno en diversos entornos empresariales. Su integración como backend de flujos de trabajo permite que departamentos enteros —desde operaciones hasta estrategia— se apoyen en su capacidad analítica sin interacción directa. Esta invisibilidad no es una limitación, sino una ventaja: Claude automatiza razonamientos, resuelve ambigüedades y conecta variables sin interferir con las interfaces visibles.

En términos prácticos, esto significa que una IA puede estar tomando decisiones internas sin “hablar” con nadie, ajustando parámetros, recomendando acciones o validando hipótesis en tiempo real. Esta forma de operación —modular, autónoma y contextual— redefine la inteligencia artificial corporativa: ya no como interfaz visible, sino como capa cognitiva embebida en los sistemas. El impacto no es inmediato ni llamativo, pero es estructural.

¿Estamos listos para delegar el criterio?

El avance de Claude y de modelos como los CTMs de Sakana plantea una pregunta clave: ¿qué tipo de tareas estamos dispuestos a delegar a una IA con criterio propio? No se trata ya de automatizar lo repetitivo, sino de externalizar fragmentos del juicio humano. Esto obliga a revisar nuestra confianza en los procesos automatizados, pero también a replantear el papel del conocimiento en las organizaciones. ¿Seguiremos formando equipos que analicen datos, o entrenaremos sistemas para hacerlo por nosotros? ¿Podemos convivir con una inteligencia que, aunque no infalible, razona mejor que nosotros en determinadas condiciones?

Tal vez el futuro no esté en una IA más rápida o más conversacional, sino en una IA más reflexiva. Y como sociedad, el verdadero reto no será tecnológico, sino cultural: aceptar que pensar despacio —como hacen Claude o Sakana— podría ser nuestra mejor estrategia frente a la complejidad.