Sakana AI y los modelos CTM: ¿el futuro de la IA reflexiva?

En un escenario dominado por titanes como OpenAI, Google y Anthropic, Sakana AI irrumpe desde Tokio con una propuesta que no busca competir por velocidad, sino por profundidad. Fundada por David Ha y Llion Jones —dos figuras clave en la historia de la IA moderna, con pasos por Google Brain y la coautoría del paper “Attention is All You Need”—, esta startup japonesa plantea una pregunta radical: ¿y si pensar más lento nos permitiera pensar mejor?

A diferencia de los modelos tradicionales entrenados para predecir rápidamente la siguiente palabra, Sakana desarrolla Continual Thinking Models (CTMs), diseñados para razonar de forma progresiva, casi como si “hablaran consigo mismos”. Esta estrategia, más que una rareza técnica, implica una visión contracultural en el mundo de la IA, donde la rapidez y la eficiencia suelen primar sobre la deliberación y el proceso. Desde su fundación en 2023, Sakana ha levantado expectativas no por el volumen de sus parámetros, sino por el cambio de paradigma que representa.

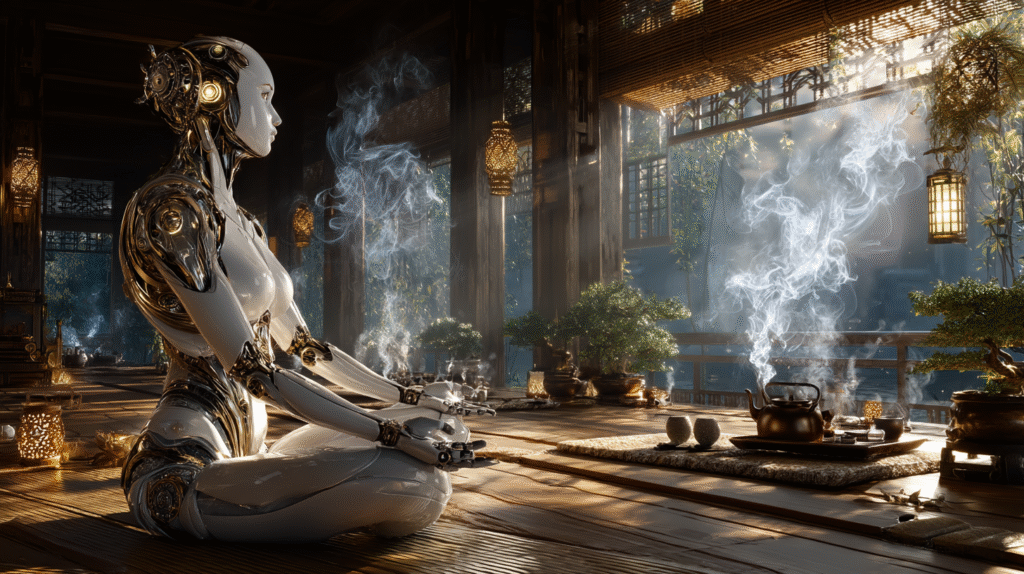

Pensar en voz baja: la biología como modelo de inteligencia

La propuesta de Sakana no se inspira en otros modelos lingüísticos, sino en la biología. En concreto, en cómo el cerebro humano procesa estímulos de forma continua, activando neuronas en secuencia y permitiendo que pensamientos complejos se desarrollen paso a paso. Sus CTMs no están diseñados para emitir una respuesta inmediata, sino para mantener un proceso de pensamiento activo que va afinando la salida conforme evalúa, retroalimenta y reformula hipótesis.

Este enfoque emula procesos como el razonamiento lógico, la planificación o la deliberación moral, donde una pausa no es un error, sino una herramienta. Lejos de ser un simple recurso estilístico, pensar en voz baja se convierte en una ventaja competitiva en contextos donde la precisión, la interpretación o el juicio son esenciales.

¿Una amenaza para los gigantes? Comparativa con los modelos dominantes

A la hora de valorar el potencial disruptivo de Sakana, la comparación con los grandes modelos del mercado es inevitable. Mientras ChatGPT, Gemini o Claude se centran en velocidad de inferencia, entrenamiento multimodal y escalabilidad, Sakana introduce una noción alternativa: la inteligencia como proceso dinámico, no como producto inmediato. Si bien aún no puede competir en términos de cobertura general o versatilidad conversacional, sus CTMs podrían tener un rendimiento superior en tareas complejas donde el step-by-step reasoning resulta crucial.

Más aún, su arquitectura modular podría facilitar la integración en sistemas híbridos, donde se combine lo mejor de ambos mundos: velocidad y profundidad. La gran pregunta es si Sakana podrá sostener este modelo a escala, mantener un ritmo competitivo de innovación y atraer comunidad y financiación en un entorno dominado por colosos tecnológicos.

Deliberación computacional: cuándo pensar lento es mejor

Los primeros resultados de los CTMs de Sakana apuntan a una especialización interesante: resolución de laberintos visuales, navegación estructurada, inferencias progresivas en entornos ambiguos.

A diferencia de un LLM tradicional, que podría intentar una solución inmediata basada en patrones anteriores, los CTMs generan una secuencia deliberativa de pasos que evalúan activamente el estado del problema en cada iteración. Esto los hace prometedores para campos como la robótica autónoma, el diagnóstico médico por imagen, la toma de decisiones estratégicas o la planificación científica. En estos casos, pensar rápido puede derivar en errores sutiles pero críticos. Pensar lento, en cambio, ofrece robustez frente a la complejidad. Como sucede en el pensamiento humano, a veces el valor no está en tener la primera respuesta, sino en construir la más adecuada.

Cultura de la inmediatez vs. inteligencia pausada

Más allá de sus capacidades técnicas, Sakana plantea una disrupción cultural. Su modelo desafía nuestra obsesión contemporánea por lo instantáneo, recordándonos que la inteligencia no siempre se manifiesta en la inmediatez. La pregunta es incómoda pero necesaria: ¿estamos preparados, como sociedad, para valorar procesos sobre resultados? ¿Podemos aceptar una IA que duda, reflexiona y se corrige a sí misma, en lugar de responder con fluidez aunque sin certeza?

Esta tensión se refleja en múltiples ámbitos, desde la educación hasta la gobernanza algorítmica. La apuesta de Sakana —aunque aún en una fase temprana— nos obliga a replantear qué entendemos por inteligencia artificial y, por extensión, qué valoramos en nuestras propias formas de conocimiento. En una época marcada por la ansiedad de la velocidad, tal vez el futuro realmente innovador esté en reaprender a pensar despacio.