Guerra y drones autónomos: Ucrania entrena la IA bélica

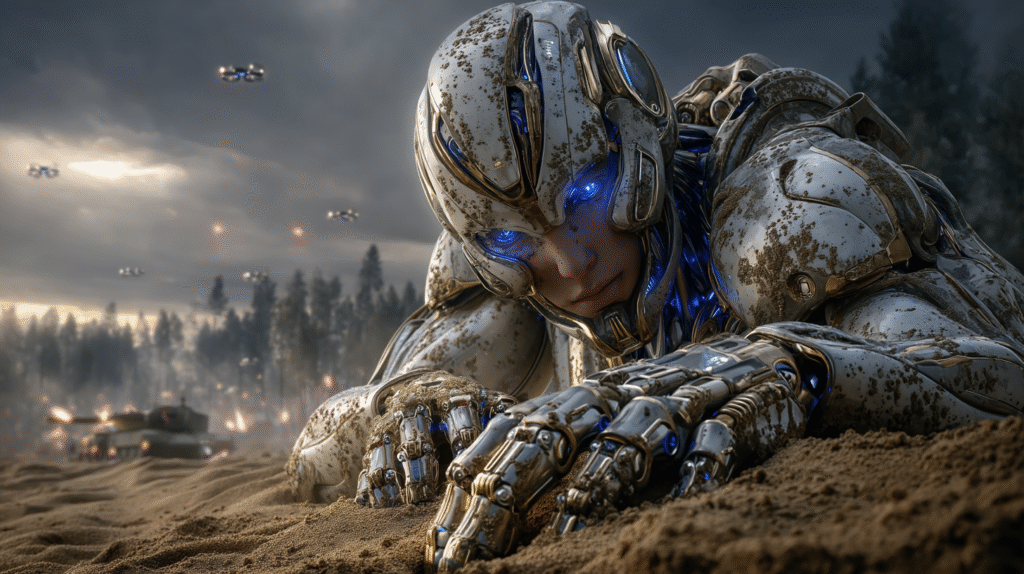

La guerra en Ucrania no solo ha transformado el equilibrio militar en Europa del Este, sino que ha dado lugar a una realidad que, hasta hace poco, solo pertenecía a la ciencia ficción: máquinas autónomas decidiendo cuándo y cómo atacar. Aunque no estamos ante T-1000 ni cyborgs de metal líquido, sí existen dispositivos letales que actúan sin intervención humana directa, integrando inteligencia artificial para identificar y abatir objetivos.

En el 70–80% de las bajas registradas se ven implicados drones, muchos de ellos con sistemas semiautónomos o totalmente automatizados. Este escenario convierte al conflicto en un laboratorio de combate con implicaciones globales. Ucrania, que hace una década cedía Crimea sin apenas resistencia, hoy produce armas efectivas, baratas y locales, reduciendo su dependencia externa y minimizando el riesgo humano. A cada ataque ruso, responde no solo con fuego, sino con innovación táctica impulsada por software.

Disfraz, señuelo y código: la nueva cara del enemigo

Uno de los efectos colaterales más inquietantes del despliegue masivo de IA en el campo de batalla es la difuminación de las fronteras entre combatiente y civil. Las tropas ucranianas y rusas emplean señuelos humanos, disfraces y patrones de comportamiento engañosos para evitar ser detectados por sistemas de visión computacional. En este nuevo escenario bélico, donde un dron puede marcar objetivos por patrones térmicos o movimientos anómalos, vestirse como un agricultor o fingir una lesión puede ser una estrategia de supervivencia.

Esto desdibuja los códigos tradicionales de la guerra, basados en reglas de identificación y proporcionalidad. Si los sistemas autónomos no distinguen entre un combatiente y un civil con certeza, ¿quién asume la responsabilidad? Las máquinas no rinden cuentas, y los humanos detrás de ellas operan cada vez más lejos del frente, tanto física como moralmente.

Ucrania como fábrica de armamento del siglo XXI

El frente oriental no solo es una trinchera de resistencia, sino también un taller de producción militar de bajo coste y alto impacto. Lo que comenzó como una necesidad —combatir sin recursos suficientes frente a un enemigo numéricamente superior— se ha convertido en una ventaja estratégica. En medio del asedio, Ucrania ha demostrado una capacidad extraordinaria para fabricar armamento modular, local y adaptado a las necesidades del terreno.

Desde drones FPV reprogramados hasta municiones impresas en 3D, el país ha reducido radicalmente su dependencia exterior. Este enfoque industrial “frugal pero letal” ha captado la atención de varios miembros de la OTAN, que observan en Ucrania un modelo replicable: maximizar eficiencia con mínima exposición humana. No es casualidad que muchos de estos prototipos estén siendo estudiados, adaptados e integrados en programas militares europeos y estadounidenses.

Sin árbitros, sin límites: el problema no es la IA, es quién la programa

A medida que los sistemas autónomos se vuelven más precisos, también se vuelven más difíciles de auditar. El fenómeno de la “caja negra algorítmica” impide entender con claridad por qué una IA decide disparar o no. Este problema no es solo técnico: es profundamente ético. ¿Quién asume la culpa si una máquina mata a un civil? ¿Quién audita el código que decide vidas humanas? Los desarrolladores de software militar, muchas veces externalizados o pertenecientes al sector privado, escapan al escrutinio público y legal.

La gobernanza de la IA en contextos bélicos aún no tiene marcos internacionales vinculantes, y las pocas directrices éticas existentes no son de cumplimiento obligatorio. Sin supervisión humana, sin transparencia y sin marcos legales robustos, estamos abriendo la puerta a una guerra sin rostro, sin reglas y sin retorno.

¿Carrera hacia el abismo o nueva era geoestratégica?

El conflicto en Ucrania es mucho más que un enfrentamiento territorial: es la apertura de una nueva era geoestratégica definida por la inteligencia artificial, la descentralización del armamento y la erosión progresiva de las normas éticas. Lo que se prueba hoy en Donetsk o en Bajmut podría estar operativo mañana en otros puntos calientes del planeta.

La pregunta ya no es si la IA debe formar parte de los sistemas defensivos, sino cómo y bajo qué principios. Sin un marco internacional que imponga límites, estamos entrando en una carrera tecnológica sin frenos, en la que el incentivo para innovar supera al impulso por regular. La era de las guerras automatizadas ha comenzado, y cada conflicto sin normas acelera su maduración. Tal vez aún no haya T-1000s, pero las decisiones de vida o muerte ya no siempre las toma un ser humano.