Por qué la seguridad en IA no puede seguir basándose solo en autoevaluación

La seguridad en inteligencia artificial ha dependido hasta ahora de lo que las propias empresas decían sobre sus sistemas. Informes técnicos, pruebas internas, compromisos públicos. Ese modelo no ha sido inútil, pero empieza a mostrar un desgaste difícil de disimular. A medida que los sistemas se integran en procesos críticos y actúan con mayor autonomía, la confianza pública ya no se sostiene solo con declaraciones. Empieza a exigir algo más básico: la posibilidad real de comprobar.

En ese contexto aparecen iniciativas como AVERi, impulsada por investigadores como Miles Brundage. No como respuesta definitiva, ni como solución técnica inmediata, sino como síntoma de que la conversación sobre seguridad está cambiando de plano. El problema ya no es únicamente lo seguros que dicen ser los sistemas, sino bajo qué condiciones esa afirmación puede verificarse desde fuera.

Cuando la autoevaluación deja de ser suficiente

Hasta ahora la autoevaluación ha sido el mecanismo dominante en seguridad de IA. Las propias empresas prueban sus modelos, documentan riesgos conocidos y publican resultados seleccionados. Esta práctica no es necesariamente engañosa. De hecho, en una fase temprana del sector fue la única viable. Nadie conocía mejor los sistemas que quienes los construían, y la velocidad de desarrollo hacía inviable cualquier forma de revisión externa estructurada.

El problema surge cuando ese mismo modelo intenta escalar. La autoevaluación funciona mientras los efectos de un sistema son acotados y su impacto social, limitado. Empieza a fallar cuando los sistemas se conectan a infraestructuras reales, toman decisiones sin supervisión directa y generan consecuencias que afectan a terceros. En ese punto, la cuestión deja de ser técnica y pasa a ser institucional. No porque las empresas actúen de mala fe, sino porque nadie puede verificar de forma independiente si lo que se afirma se cumple en la práctica.

Ese es el límite reputacional de la autoevaluación. No se rompe de golpe, pero se erosiona. Cada incidente, cada fallo no anticipado, refuerza la percepción de que confiar solo en lo que los propios desarrolladores publican ya no es suficiente.

Qué significa verificar un sistema de IA

Antes de avanzar, conviene aclarar términos. Verificar no es lo mismo que prometer ni que explicar. Verificar significa que una afirmación puede comprobarse mediante procedimientos definidos, por alguien que no depende de quien hace la afirmación. En el ámbito de la IA, implica que los riesgos, los controles y los límites de un sistema no solo se describen, sino que pueden revisarse.

Aquí entra la auditoría externa. Una auditoría no es un juicio moral ni una garantía absoluta de seguridad. Es una revisión realizada por un tercero independiente, con métodos claros y criterios conocidos, que permite evaluar si un sistema cumple ciertos estándares. No elimina el riesgo, pero introduce responsabilidad comprobable.

Esta distinción es clave porque buena parte del debate público confunde transparencia con verificabilidad. Publicar información ayuda, pero no sustituye la posibilidad de contrastarla. Un informe interno puede ser detallado y honesto, y aun así resultar insuficiente si nadie externo puede evaluar sus conclusiones.

De las pruebas internas a los niveles de garantía

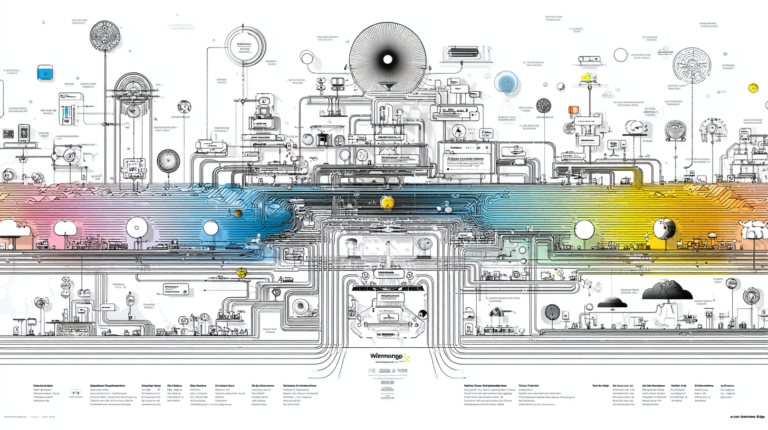

La propuesta de AVERi se sitúa precisamente en ese terreno. Su marco de referencia plantea distintos niveles de garantía en sistemas de IA, entendidos como grados crecientes de verificación. En el nivel más básico se encuentran las pruebas internas, similares a las actuales. En niveles más avanzados aparecen revisiones externas, requisitos compartidos y, en el extremo, esquemas que recuerdan a acuerdos internacionales.

Lo relevante no es la escala concreta, sino el enfoque. AVERi no pretende convertirse en auditor ni certificar sistemas. Su objetivo es empujar estándares y políticas que hagan posible la auditoría. Es decir, crear las condiciones para que otros puedan verificar de forma independiente lo que hoy solo se declara.

Ese matiz importa porque evita una falsa dicotomía. No se trata de elegir entre autorregulación total o control estatal inmediato. Se trata de construir infraestructuras de confianza que permitan pasar de la promesa a la comprobación sin bloquear el desarrollo tecnológico.

Apoyo interno y tensiones no resueltas

Un detalle que ha llamado la atención es que parte de la financiación de este tipo de iniciativas provenga de empleados de grandes laboratorios de IA. No es una prueba de conflicto ni una denuncia encubierta, pero sí una señal. Sugiere que dentro de las propias organizaciones existe conciencia de los límites del modelo actual.

Quienes trabajan con estos sistemas conocen mejor que nadie su complejidad, sus dependencias y sus puntos ciegos. También saben que, a medida que la IA se integra en estructuras operativas reales, la carga de responsabilidad crece. En ese contexto, apoyar marcos que faciliten la verificación externa puede leerse como un intento de cambiar las reglas antes de que el desgaste reputacional las cambie por la fuerza.

Hablar de incentivos resulta más útil que hablar de intenciones. La autoevaluación protege agilidad y control, pero también concentra riesgos. La verificación externa redistribuye esos riesgos, aunque introduzca fricción. El equilibrio entre ambos modelos todavía está lejos de resolverse.

Estándares auditables como punto de partida regulatorio

La discusión regulatoria suele atascarse en grandes principios. Declaraciones amplias sobre seguridad, ética o responsabilidad generan consenso, pero poca capacidad operativa. Una vía más pragmática consiste en exigir estándares auditables. No definir qué es un sistema “seguro” en abstracto, sino establecer qué debe poder comprobarse.

Desde esta perspectiva, la regulación no dicta soluciones técnicas, sino condiciones mínimas de verificación. Obliga a que existan registros, procesos y accesos que permitan evaluar cómo funciona un sistema y qué riesgos asume. Es un enfoque menos ambicioso en lo declarativo, pero más efectivo en lo práctico.

Esta lógica conecta con un cambio más amplio en el ecosistema tecnológico. A medida que los sistemas automatizados crean estructura —identidades, permisos, flujos autónomos— la gobernanza deja de ser opcional. Auditar no es castigar, es hacer gobernable lo que ya actúa.

La confianza pública en la inteligencia artificial no desaparece de un día para otro. Se debilita cuando nadie externo puede comprobar nada relevante. Iniciativas como AVERi no prometen resolver ese problema, pero sí señalan con claridad dónde está el frente. El debate ya no gira solo en torno a lo que los modelos pueden hacer, sino a qué condiciones aceptamos para creer en ellos.