Millones ya preguntan a la IA antes de llegar al sistema sanitario

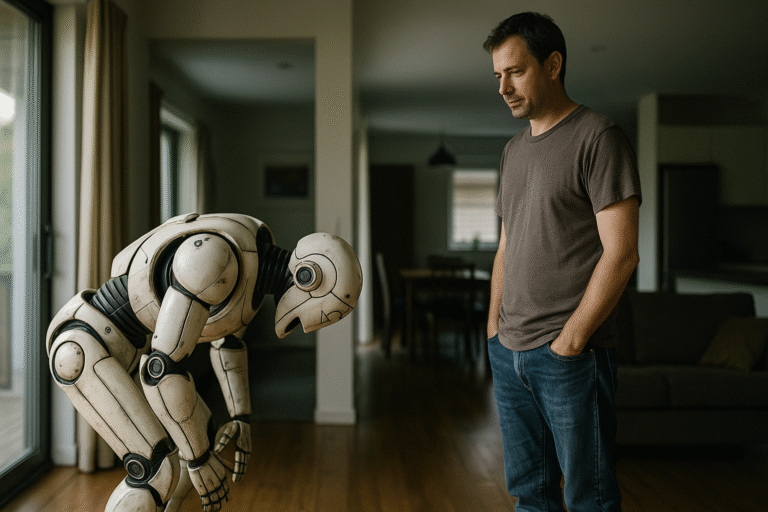

La inteligencia artificial ya forma parte de la vida sanitaria cotidiana de millones de personas. No como dispositivo médico certificado ni como sustituto del profesional, sino como algo más difuso y, por eso mismo, más difícil de gobernar: una capa previa de orientación, interpretación y calma —o inquietud— que aparece antes de la consulta, fuera del horario clínico y, en muchos casos, fuera del radar institucional. El debate, por tanto, ha dejado de ser si se usan estas herramientas. La cuestión real es qué ocurre cuando su uso se normaliza antes de que existan reglas compartidas.

Hablar hoy de IA y salud sin reconocer ese punto de partida es discutir un problema que ya no existe. Millones de personas consultan síntomas, entienden informes, preparan visitas médicas o navegan por seguros de salud con ayuda de modelos conversacionales como los de OpenAI. No porque confíen ciegamente en la tecnología, sino porque el sistema tradicional no siempre está disponible cuando surge la duda. La IA entra ahí. No como revolución declarada, sino como solución informal a una carencia estructural.

Cuando el síntoma llega antes que el sistema

Buena parte de estas consultas ocurren en momentos y lugares donde la medicina organizada no llega. De noche. En zonas rurales. En contextos donde pedir cita implica días de espera o kilómetros de distancia. No se trata de sustituir al médico, sino de ordenar la percepción del problema antes de llegar a él. Saber si algo puede esperar, cómo explicarlo mejor o qué preguntas conviene llevar preparadas.

Este uso no responde a campañas institucionales ni a políticas públicas. Es una adopción espontánea, casi doméstica, que crece porque encaja con una necesidad real. Y ahí está el punto incómodo: cuanto más cotidiano se vuelve, menos excepcional parece, y menos urgencia hay por definir estándares. El resultado es una práctica masiva sin marco común, sostenida sobre promesas de “información general” que, en la práctica, influyen en decisiones concretas.

La IA no es una recién llegada a la medicina. Sistemas de inteligencia artificial se están integrando en hospitales para tareas administrativas y clínicas, con beneficios claros, pero también con tensiones evidentes sobre privacidad, control y deshumanización. La diferencia ahora es que no hay institución que actúe como filtro. El usuario está solo frente a la herramienta.

El triaje que no reconoce su nombre

Nadie diría que consultar a una IA es hacer triaje médico. Sin embargo, muchas de esas interacciones cumplen una función similar: priorizar, descartar, tranquilizar o alertar. No diagnostican, pero reordenan el riesgo percibido. Y eso tiene efectos. Una persona que decide no acudir a urgencias, otra que adelanta una visita, alguien que insiste más porque “la IA dijo que podía ser serio”.

Este triaje informal no tiene protocolos compartidos ni auditorías externas. Depende del modelo, de cómo fue entrenado, de cómo formula el usuario la pregunta y del contexto cultural en el que se interpreta la respuesta. Normalizarlo sin reconocer su naturaleza es aceptar una forma de mediación sanitaria sin responsabilidad clara. No porque la IA “se equivoque”, sino porque nadie ha definido qué significa acertar en este contexto.

La paradoja es que el sistema sanitario sí se preocupa, con razón, por regular herramientas mucho más controladas. Desde algoritmos clínicos hasta descubrimientos farmacológicos asistidos por IA, el foco regulatorio está puesto donde el riesgo es visible y formal. Pero la influencia cognitiva previa, esa que actúa antes del diagnóstico y fuera del expediente médico, sigue tratándose como asunto privado.

Gobernar después de adoptar

Los intentos de las agencias regulatorias por adaptarse a la inteligencia artificial llegan, como casi siempre, después de la adopción social. La Food and Drug Administration explora vías para evaluar dispositivos médicos basados en IA, consciente de que los marcos clásicos no encajan bien con sistemas que aprenden y cambian. Es un esfuerzo necesario, pero parcial.

Porque el problema ya no se limita a dispositivos certificados. La práctica cotidiana ha ido por delante. La IA no espera a ser reconocida como herramienta médica para influir en la experiencia de la enfermedad. Actúa en un espacio gris, entre la información general y la orientación personal, donde la regulación tradicional se siente incómoda. Regular tarde no es solo llegar después; es regular otra cosa.

Aquí se repite un patrón ya visible en el ámbito del descubrimiento científico. La IA ha demostrado ser capaz de proponer moléculas, tratamientos y enfoques que ningún humano habría imaginado, abriendo promesas médicas enormes. Pero también ha dejado claro que la velocidad técnica supera con creces la capacidad de las instituciones para entender, evaluar y distribuir esos avances de forma equitativa. Con el uso cotidiano ocurre algo similar, aunque en silencio.

Responsabilidad sin autor único

Cuando una IA “solo informa”, ¿quién responde por su influencia? El desarrollador señala que no da consejos médicos. El sistema sanitario recuerda que no es una consulta. El usuario asume que es una ayuda, no una decisión final. En ese cruce, la responsabilidad se diluye. No hay un error claro que señalar, pero sí un efecto acumulativo difícil de ignorar.

El riesgo no es un fallo catastrófico, sino la normalización de una mediación sin reglas. Que millones de personas incorporen estas herramientas a su gestión de la salud sin que exista una conversación pública sobre límites, calidad o supervisión. No se trata de prohibir ni de alarmar, sino de reconocer que lo informal también gobierna conductas.

Aceptar la IA en hospitales, en laboratorios y en políticas de salud exige coherencia. Si se reconoce su capacidad para aliviar cargas, descubrir tratamientos o anticipar riesgos, resulta insostenible seguir tratándola como algo neutro cuando actúa en la vida diaria. La pregunta no es si la IA debe estar en salud. Ya está. La cuestión es si vamos a seguir mirándola como un uso privado cuando sus efectos son, claramente, estructurales.

El debate, en el fondo, no es tecnológico. Es político. Y llega tarde, como casi siempre, justo cuando la consulta ya existe.