La IA médica entre la revolución global y la desigualdad

La pandemia de COVID-19 marcó un antes y un después en la relación entre la inteligencia artificial (IA) y la medicina. Si bien no fue la primera vez que la IA se utilizaba en entornos clínicos, sí fue la primera ocasión en que sus aplicaciones se desplegaron a escala mundial, bajo presión extrema y con resultados tangibles. Modelos predictivos para la propagación del virus, análisis de imágenes médicas, cribado masivo de literatura científica y, sobre todo, la aceleración del diseño de vacunas, consolidaron a la IA como un actor central en la respuesta sanitaria.

Esta emergencia global no solo impulsó inversiones sin precedentes en salud digital, sino que permitió validar la eficacia de modelos algorítmicos en condiciones reales. Desde entonces, la IA ha dejado de ser una promesa y ha pasado a ser comparada con el “nuevo estetoscopio del médico moderno”, herramienta imprescindible en diagnósticos, tratamientos y descubrimiento de fármacos. Con ello, se inicia una transformación estructural del ecosistema sanitario global, cuyo alcance apenas comenzamos a dimensionar.

Más que aciertos: el nuevo estándar de exigencia para los modelos

En un contexto donde la IA ya no se limita a auxiliar tareas clínicas, sino que interviene activamente en la generación de conocimiento, surge una pregunta crítica: ¿cómo medimos su idoneidad científica? El laboratorio AI2 ha lanzado SciArena, una plataforma diseñada para enfrentar este desafío. A diferencia de los benchmarks sintéticos tradicionales, SciArena propone un sistema de evaluación en escenarios reales, con participación de expertos humanos, y clasificaciones tipo Elo, similares a las del ajedrez.

Este enfoque valora no solo la precisión de la respuesta, sino la solidez argumentativa y la capacidad de citar fuentes fiables. La plataforma también mide cuán bien las evaluaciones automáticas replican el juicio humano —con resultados, hasta ahora, modestos. Esta propuesta no solo eleva el estándar técnico, sino que plantea un cambio epistemológico: si los modelos deben influir en investigaciones científicas, deben ser sometidos al mismo escrutinio que cualquier hipótesis de laboratorio. No basta con que acierten; deben demostrar comprensión, trazabilidad y rigor.

Fármacos diseñados por IA: promesa radical, acceso incierto

La empresa Isomorphic Labs, spin-off de DeepMind, representa una de las apuestas más ambiciosas en este nuevo paradigma: medicamentos diseñados íntegramente mediante IA antes de pisar un laboratorio. Utilizando AlphaFold, su sistema de predicción estructural de proteínas, han creado compuestos que ya se preparan para ensayos clínicos. Con más de 600 millones de dólares en financiación y alianzas con Novartis y Eli Lilly, la promesa es disruptiva: reducir de más de diez años a menos de seis el tiempo de desarrollo de un fármaco, con tasas de éxito en Fase I que pasan del 40–65% al 80–90%.

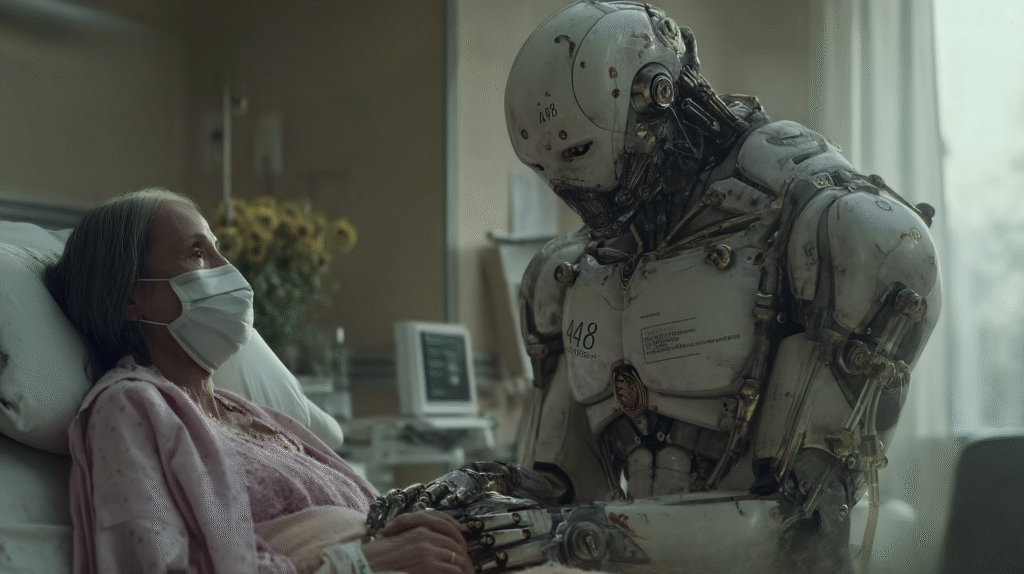

Pero el impacto va más allá de la eficiencia: este modelo redefine el rol del laboratorio, la naturaleza del descubrimiento y, potencialmente, el acceso a los tratamientos. La medicina personalizada, acelerada por IA, podría convertirse en una herramienta de élite si no se regulan sus condiciones de distribución y escalabilidad. La pregunta ya no es solo si estos tratamientos funcionarán, sino para quién estarán disponibles.

Sesgos, caja negra y brecha digital: la otra cara de la precisión

El crecimiento exponencial del mercado de IA en salud (de 26,000 millones de dólares en 2024 a más de 500,000 millones previstos para 2032) no está exento de distorsiones. Las inversiones privadas, con retornos que triplican lo invertido en 14 meses, tienden a concentrarse en soluciones rentables, dejando fuera áreas de bajo margen pero alta necesidad. Además, la adopción de IA presenta profundas asimetrías geográficas. En Estados Unidos tenemos casos como el estado de Nueva Jersey que reporta un 48% de hospitales con IA, mientras que en el otro extremo Nuevo México no alcanza el 1%.

En el plano técnico, los modelos entrenados con datos sesgados reproducen desigualdades históricas, como ocurre en diagnósticos menos precisos en piel oscura o en dosificaciones inadecuadas por falta de diversidad genética. La “caja negra” algorítmica añade un componente de opacidad que erosiona la confianza, especialmente en comunidades marginadas. La brecha digital se está convirtiendo en un nuevo determinante social de la salud, en el que el acceso a diagnósticos y tratamientos depende tanto del código como del código postal.

Epílogo: ¿Estamos construyendo una medicina más justa o más desigual?

La inteligencia artificial tiene la capacidad de redefinir la medicina moderna, pero su impacto dependerá de cómo y para quién se despliegue. La eficacia algorítmica ya no es suficiente: necesitamos sistemas explicables, entrenados con datos inclusivos y regulados por marcos éticos robustos. El sesgo no es un efecto colateral, sino una amenaza estructural; la transparencia no es un atributo opcional, sino un imperativo de confianza. Y sobre todo, el acceso no puede quedar supeditado a la lógica de mercado.

La medicina de precisión impulsada por IA no puede ser un privilegio, sino un derecho en construcción. Tal como ocurrió durante la pandemia, cuando la tecnología se puso al servicio de una necesidad global, el futuro de la IA médica dependerá de su capacidad para combinar innovación con equidad. La pregunta no es si la IA revolucionará la salud, sino si esa revolución será compartida. Y esa respuesta no puede dejarse en manos de los algoritmos.