Conexión Pública #64

PULSA SOBRE LA IMAGEN PARA ESCUCHAR EL EPISODIO

El episodio 64 de Conexión Pública funciona como un punto de inflexión. No porque cierre el debate sobre la inteligencia artificial, sino porque cambia el lugar desde el que se formula la pregunta. Ya no se trata de si la tecnología es capaz, ni siquiera de si es rentable. La cuestión que atraviesa todo el episodio es otra: qué ocurre cuando la IA deja de ser una herramienta añadida y empieza a operar como una capa estructural dentro de organizaciones, sistemas y decisiones reales.

Este número no mira hacia el futuro. Mira de frente al presente. A un presente en el que la inteligencia artificial empieza a presionar “hacia dentro”: de los procesos, de las jerarquías, del criterio humano. Y en ese movimiento silencioso aparecen tensiones nuevas (de gobierno, de identidad, de confianza) que no se resuelven con más potencia de cálculo.

Volver al origen para entender el presente

La primera parte del episodio cierra una serie larga: Los dueños del algoritmo. Quince entregas que han ido recorriendo la genealogía del poder en la inteligencia artificial. El cierre no podía ser otro que el regreso al origen del deep learning, a las personas que hicieron posible que hoy hablemos de modelos, agentes y asistentes como algo cotidiano.

Geoffrey Hinton, Yann LeCun y Yoshua Bengio no solo impulsaron una técnica. Rescataron una idea que durante décadas fue considerada marginal: que las redes neuronales podían aprender representaciones útiles del mundo si se les daban datos, computación y métodos adecuados. Entre los años ochenta y principios de los dos mil, cuando el conexionismo parecía un callejón sin salida, ellos insistieron.

El reconocimiento institucional (Premio Turing en 2018, Premio Princesa de Asturias en 2022) certificó algo más profundo que trayectorias individuales: la revolución de la IA no nació en una startup ni en un laboratorio corporativo, sino en décadas de investigación paciente. Y, sin embargo, hoy esas mismas personas miran el futuro desde lugares muy distintos.

Hinton se ha convertido en una de las voces más críticas, alertando de riesgos sistémicos y renunciando a su posición en Google para hablar con libertad. LeCun, desde Meta, rechaza el catastrofismo y defiende modelos abiertos y una IA que aprenda del mundo físico sin miedo paralizante. Bengio ocupa una posición intermedia, impulsando iniciativas como LawZero y defendiendo una seguridad “por diseño”, con marcos éticos y regulatorios claros.

La divergencia importa porque no nace de la ignorancia, sino del conocimiento profundo. No es un debate especulativo, sino una discusión entre quienes han construido la tecnología pieza a pieza. Por eso la pregunta que cierra esta serie no es retórica: ¿puede el deep learning conducirnos a una inteligencia general segura o necesitará límites globales, como los que empieza a dibujar la Ley de IA de la Unión Europea?

Volver al origen no es nostalgia. Es recordar que antes de los modelos hubo personas. Y que entender la IA exige entender también sus desacuerdos.

Cuando el avatar deja de ser un truco

La herramienta de la semana no busca acelerar ni resumir. Busca sostener. LongCat-Video-Avatar aparece en el episodio como un síntoma claro de madurez tecnológica: el problema ya no es generar un rostro que hable durante diez segundos, sino mantener una presencia creíble durante minutos u horas.

Desarrollado por el equipo LongCat de Meituan y publicado como open source, este modelo aborda uno de los grandes puntos débiles del vídeo generado con IA: la fragilidad temporal. Hasta ahora, muchos sistemas funcionaban bien en clips cortos, pero se descomponían al alargarse: gestos repetitivos, labios que seguían moviéndose en silencio, cuerpos congelados.

LongCat introduce decisiones técnicas pensadas para el largo recorrido. Permite generar vídeo a partir de audio y texto, combinar audio, texto e imagen, o continuar un vídeo existente con una nueva pista de audio. El resultado es la posibilidad de crear vídeos de duración ilimitada, mantener conversaciones largas, introducir varios personajes y conservar una identidad visual coherente.

Lo relevante no es solo la calidad visual, sino la lógica que hay detrás. El cuerpo del avatar “sigue vivo” incluso cuando no hay voz. Se evita el efecto copy-paste de gestos idénticos y se cosen fragmentos a nivel latente para que el flujo sea continuo. No es una demo pensada para anuncios, sino una infraestructura para narrativas largas: podcasts en vídeo, presentadores virtuales, contenidos educativos extensos.

Frente a soluciones comerciales que imponen límites de duración y dependen de la nube, LongCat permite despliegue local, no restringe el tiempo y soporta interacciones multi-persona. No es una herramienta para cualquiera, pero sí una base potente para quien necesita control y continuidad.

El mensaje implícito es claro: cuando el contenido deja de ser corto, la credibilidad deja de ser un detalle técnico y se convierte en condición básica.

Artículos que apuntan en la misma dirección

La sección de artículos de la semana funciona como un eco editorial del resto del episodio. No hablan de nuevas funciones ni de modelos más grandes. Hablan de quién decide, quién asume el coste y quién conserva el criterio cuando la IA se convierte en infraestructura.

Con la colaboración de NotebookLM el repaso conecta piezas que, juntas, dibujan un cambio de fase. La ventaja competitiva ya no está en adoptar antes, sino en saber qué no delegar, qué proteger y qué límites poner cuando la IA empieza a ocupar espacio físico, político y cultural.

Lo que emerge entre líneas es una pregunta incómoda: ¿cómo se gobierna una tecnología que ya no sorprende, pero organiza? La IA deja de competir por atención y empieza a competir por administración. Y ahí entran en juego la confianza, la identidad profesional, los recursos y el poder de decisión.

El valor de quitar capas

El prompt de la semana va a contracorriente del discurso dominante. No sirve para producir más ni para optimizar lo existente, sino para eliminar. Se presenta como un “analista externo de simplificación organizativa”, sin diplomacia innecesaria.

La lógica es simple y radical: describir los procesos tal y como son, sin justificar nada, y pedirle a la IA que identifique dónde se ha añadido complejidad innecesaria. No para hacer un roadmap, sino para recomendar una única simplificación inmediata, imponible esta misma semana.

La potencia del ejercicio no está en el texto del prompt, sino en su uso. Obliga a describir pasos reales, aprobaciones, herramientas duplicadas. A aceptar que muchas capas existen por miedo, por hábito o por ambigüedad de responsabilidades. Y a asumir que avanzar no siempre es hacer mejor lo que ya hacemos, sino dejar de hacer cosas que nunca debieron quedarse.

En un momento en el que casi todas las conversaciones van de añadir —más control, más procesos, más herramientas—, este enfoque funciona como higiene organizativa.

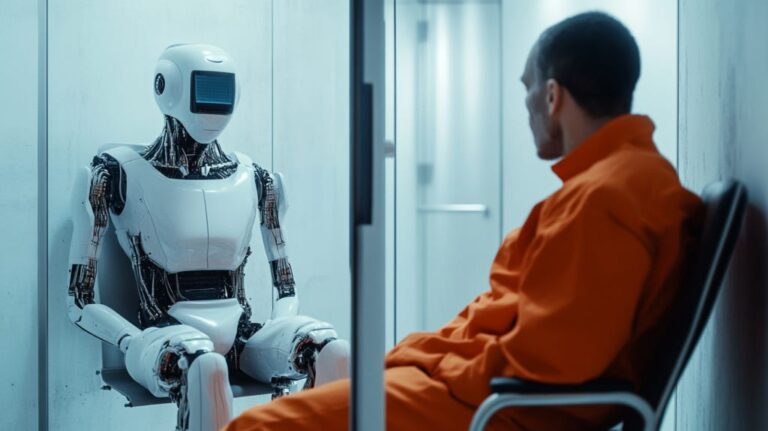

Tres decisiones que ya no esperan

La sección IA en acción baja definitivamente la conversación a tierra. Tres casos reales, en sectores muy distintos, pero con una señal común: la IA ya no solo recomienda, decide.

El primero llega del mundo empresarial. Cribl ha incorporado un agente de Zip para revisar contratos, detectar sobrepagos y renegociar acuerdos menores con proveedores. No es apoyo, es automatización real de la negociación, con ahorros anuales cercanos a los tres millones de dólares. El precedente es inquietante y lógico a la vez: agentes negociando entre sí en mercados B2B.

El segundo caso se sitúa en un entorno crítico. Duke Health, junto a Trase Systems, ha usado agentes de IA para optimizar recetas médicas. El éxito no está solo en el modelo, sino en el despliegue híbrido, con ingenieros trabajando junto al personal sanitario. Procesos tres veces más rápidos y ahorro anualizado, pero, sobre todo, legitimidad en un entorno regulado.

El tercero nos lleva al deporte profesional. NBA y NHL han respaldado a Fastbreak AI para automatizar la programación de competiciones. Calendarios, sedes, retransmisiones, descansos. Optimización silenciosa, poco vistosa, pero estructural.

Tres ejemplos que confirman la misma idea: la IA empieza a decidir dentro de sistemas reales, con consecuencias económicas, operativas y culturales.

Gobernar antes que acelerar

El cierre del episodio recoge el hilo que lo atraviesa todo. La inteligencia artificial ya no es una capa externa. Es una infraestructura que redefine cómo se decide, cómo se negocia y cómo se legitima el criterio.

Cuando los modelos se parecen y los agentes ejecutan, la pregunta deja de ser técnica. Pasa a ser política y organizativa: quién gobierna el uso, quién asume el coste y quién responde cuando algo falla. También aparece una advertencia incómoda: no todo debería optimizarse. Hay fricciones —en el aprendizaje, en la autoría, en el juicio profesional— que funcionan como protección.

Escuchar este episodio es aceptar que el reto ya no es ir más rápido, sino avanzar con criterio.