Hablar en un mundo que ya no escucha igual

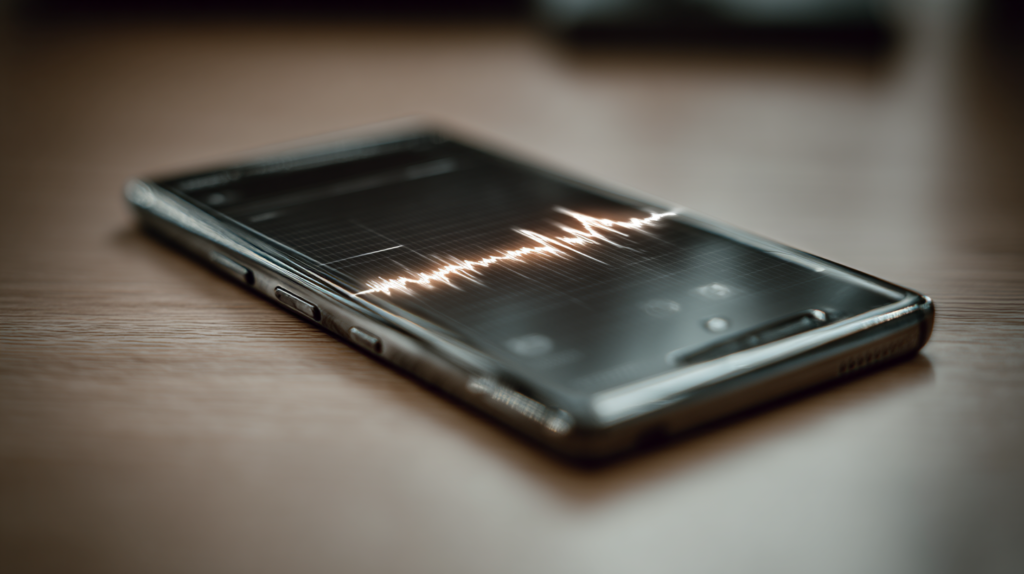

La voz ha sido tradicionalmente un canal cómodo, cercano, casi anecdótico frente al dominio del texto y la imagen. Hoy ya no lo es. La voz se ha convertido en interfaz cotidiana: activa dispositivos, autentica identidades, acompaña procesos educativos y media la creación de contenidos. En ese contexto aparece un hecho aparentemente técnico, la clonación de voz ejecutada de forma local, sin nube y con segundos de audio, que obliga a revisar algo más profundo. No es una mejora incremental. Es un cambio de condiciones.

La tesis es sencilla y, a la vez, incómoda: justo cuando la voz se consolida como infraestructura universal, la posibilidad de clonarla en local redefine la relación entre privacidad, poder y control. No porque elimine los riesgos, sino porque desplaza quién decide y desde dónde.

La voz ya no es un medio: es una llave

La transformación ha sido silenciosa. La voz dejó de ser solo un vehículo expresivo para convertirse en mecanismo de acceso. Se usa para desbloquear dispositivos, autorizar acciones, personalizar servicios y construir presencia en entornos digitales. Ya no se limita a comunicar: habilita.

Ese desplazamiento tiene consecuencias. Cuando la voz funciona como llave, deja de ser únicamente una señal humana y pasa a operar como dato. Un dato especialmente delicado, porque no se puede cambiar con facilidad y porque está íntimamente ligado a la identidad. A diferencia de una contraseña, la voz se filtra sin que lo notemos. Está en llamadas, vídeos, audios reenviados, notas de voz. La superficie de exposición es enorme.

El problema no es que la tecnología «imite mejor». Es que la voz ha perdido su estatus de prueba natural. Durante siglos, escuchar fue una forma de verificar presencia. Hoy, escuchar ya no garantiza nada. Ese quiebre es el punto de partida de todo lo demás.

De la abundancia al colapso de confianza

La síntesis de voz ha pasado de demos breves a relatos extensos, de frases sueltas a horas de conversación continua. La producción ha dejado de ser el límite. Cualquiera puede generar audio, multiplicarlo, transformarlo, escalarlo.

Pero la abundancia no ha venido sola. Trae consigo una erosión progresiva de la confianza. El fraude vocal deja de ser excepcional para convertirse en paisaje: llamadas que imitan voces familiares, audios que circulan fuera de contexto, grabaciones que «suenan reales» pero no lo son. No hace falta un colapso abrupto. Basta la repetición.

Lo más inquietante no es la existencia del engaño, sino su normalización. Hemos aprendido a desconfiar de la voz del mismo modo que aprendimos a desconfiar de las imágenes. Y lo hemos hecho sin herramientas claras para responder. La desconfianza se volvió un reflejo cultural, no una estrategia consciente.

En ese escenario, las soluciones propuestas hasta ahora han sido externas: etiquetas, marcas, advertencias, intermediarios que certifican. Todas parten de la misma premisa: la voz se genera y se gestiona dentro de plataformas que prometen control. Esa premisa empieza a resquebrajarse.

Clonación local: menos espectacular, más política

La clonación de voz ejecutada localmente introduce un giro que no es visual ni llamativo. No promete voces perfectas ni efectos cinematográficos. Promete algo más discreto: que el proceso ocurra en el dispositivo, sin enviar datos sensibles a terceros.

Ese detalle cambia la discusión. No elimina el fraude ni garantiza seguridad automática. Pero modifica la arquitectura del poder. Cuando la voz se clona en la nube, la privacidad es una política. Cuando se clona en local, la privacidad es una decisión técnica. La diferencia importa.

En un ecosistema acostumbrado a delegar confianza en proveedores, la ejecución local devuelve agencia al usuario. No porque lo convierta en soberano absoluto, sino porque reduce dependencias. Menos intermediarios significa menos puntos opacos, pero también más responsabilidad individual. No hay plataforma a la que reclamar ni sello que tranquilice.

Por eso el cambio es político. No se trata de celebrar la tecnología, sino de entender qué tipo de control redistribuye. La clonación local no es el final del problema; es el inicio de otro marco de negociación.

Accesibilidad, control y la nueva intimidad técnica

El impacto no se limita a la seguridad. La clonación de voz local abre posibilidades reales en accesibilidad, educación y creación. Personas con dificultades de habla pueden recuperar una voz propia. Docentes y creadores pueden trabajar con herramientas personalizadas sin exponer datos sensibles. La tecnología deja de ser solo mediática para volverse íntima.

Pero esa intimidad también es frágil. Si cualquiera puede generar una voz sin mediadores, la frontera entre uso legítimo y abuso se vuelve más difusa. El control individual crece, pero también lo hace la necesidad de criterio. No todo lo técnicamente posible es socialmente deseable.

Aquí aparece la tensión central: más control personal no equivale automáticamente a más confianza colectiva. La arquitectura local empodera, pero no sustituye los pactos sociales. Obliga a pensar en nuevas formas de responsabilidad que no dependan exclusivamente de leyes ni de plataformas.

Cuando la confianza deja de ser automática

La clonación de voz local no es una solución mágica ni una amenaza definitiva. Es un síntoma de madurez tecnológica y, al mismo tiempo, de fragilidad cultural. Nos obliga a aceptar que la voz ya no es solo expresión, sino infraestructura. Algo que se gestiona, se protege y se disputa.

Hablar vuelve a ser un dato sensible porque vuelve a importar quién lo controla. La pregunta no es si podremos generar más voces, sino bajo qué condiciones decidimos hacerlo. En ese espacio, todavía abierto, se juega la posibilidad de reconstruir confianza sin renunciar a la autonomía. No será un proceso limpio ni rápido. Pero es, quizá, el único camino razonable.