El agente enjaulado redefine el trabajo digital

Cada semana, el ecosistema cambia, se reorganiza y se fragmenta. La inteligencia artificial ya no se despliega en modelos aislados, sino en espacios de ejecución: terminales, navegadores, entornos de desarrollo integrado (IDE) y bandejas de entrada. La carrera ya no es por la capacidad de razonamiento, sino por la posición en el flujo real del trabajo.

Anthropic y OpenAI han realizado dos movimientos que reconfiguran este mapa. Claude Code llega al navegador, ejecutando tareas en sandboxes paralelos; OpenAI lanza Atlas, un navegador con ChatGPT nativo, memoria persistente y agentes que actúan sobre las aplicaciones del usuario. Dos anuncios cercanos en el tiempo revelan una misma tensión: cómo diseñar autonomía dentro de límites negociados.

Ambas compañías coinciden en un punto: el futuro del trabajo no pasa por más inteligencia, sino por una inteligencia controlada.

De la terminal al navegador, el nuevo teatro del control

Hasta ahora, la IA vivía en la interfaz del chat, un lugar seguro y delimitado que mantenía la ilusión de conversación. Pero el salto a la web lo cambia todo. Con Claude Code, Anthropic convierte el navegador en un entorno de desarrollo completo: ejecución, depuración, conexión con Git y gestión de dependencias, todo sin salir de la pestaña.

Este desplazamiento tiene un efecto inmediato: la IA se instala donde ocurre la acción, no donde se la consulta. Lo que antes era diálogo se vuelve colaboración; lo que antes era texto, ahora es contexto.

El paso al navegador reduce la fricción técnica —sin instalaciones ni entornos locales— y multiplica el alcance más allá del perfil de programador. Cualquiera puede usar un IDE sin saber configurarlo. Pero también introduce una nueva capa de dependencia: el entorno de trabajo deja de pertenecer al usuario y pasa a estar intermediado por el agente.

Sandboxes y mínima confianza, ingeniería de límites

Anthropic describe su nuevo modelo como sandboxed autonomy. Cada sesión de Claude Code se ejecuta en un entorno aislado, sin acceso directo al sistema local. Las operaciones sobre repositorios se canalizan a través de un proxy con el principio de mínimo privilegio.

El resultado es una forma de confianza contenida. El sistema reduce en un 84 % los prompts de aprobación manual, sin eliminar las revisiones de seguridad. El usuario deja de autorizar cada paso, pero sigue pudiendo auditarlo después.

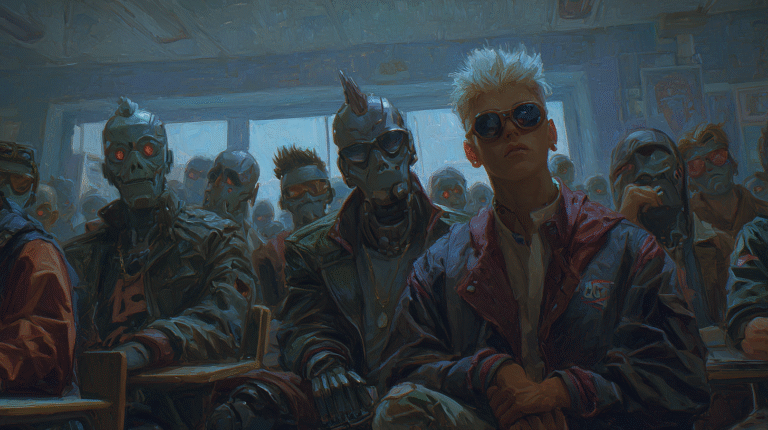

La idea de fondo no es solo técnica, sino también política: cómo permitir que un agente actúe con iniciativa sin ceder soberanía. Claude Code inaugura así una pedagogía de la autonomía restringida, donde el valor no reside en ejecutar más rápido, sino en hacerlo bajo un marco explícito de límites.

En términos prácticos, la IA no pide permiso a cada instante, pero tampoco asume que todo está permitido. Una lección que, si se extiende, podría marcar el tono de la próxima generación de agentes.

Atlas, el navegador como organismo inteligente

En paralelo, OpenAI ha lanzado Atlas, su primer navegador-agente. La diferencia con Claude es de escala: no es un IDE para desarrolladores, sino un entorno universal de tareas. Atlas integra ChatGPT con memoria persistente, acciones automáticas y acceso contextual al correo, al calendario y a las tiendas en línea. El Comet de Perplexity ya no está solo.

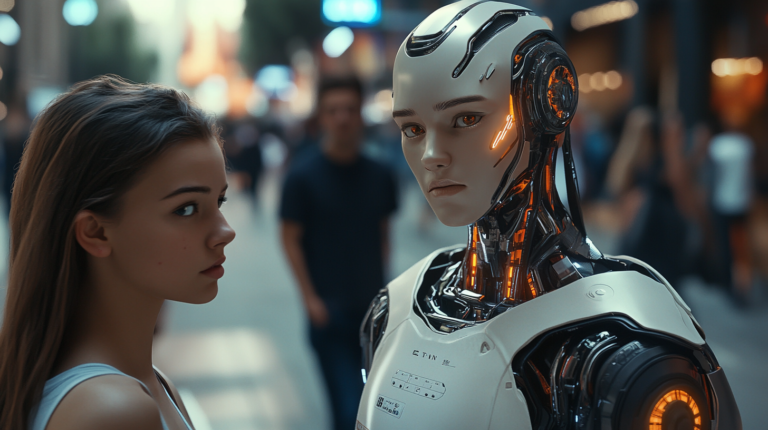

El movimiento refleja una ambición distinta: poseer el “momento cero” de la tarea, ese instante en que el usuario decide qué hacer. Hasta ahora, ese papel lo ocupaba el buscador. Atlas lo sustituye por el acto de pedir directamente al agente: redacta, busca, reserva, compra, responde.

El diseño se orienta al consumidor común: incorporación en minutos, configuración mínima y contexto inmediato. Pero el control sigue siendo negociado. El navegador puede añadir productos al carrito o generar un correo, pero nunca ejecutar la compra o el envío sin confirmación explícita.

OpenAI denomina a esto responsible agency grammar: una gramática de agencia responsable, una estructura que, más que limitar, enseña a convivir con la autonomía artificial.

El IDE-agente, autonomía sin soberanía

Claude y Atlas operan sobre un mismo principio: conceder libertad sin ceder poder. En ambos casos, el usuario delega tareas, pero no responsabilidad. El agente actúa, pero no decide.

Esta dinámica transforma el sentido de “herramienta”. Un IDE como Claude Code no se limita a ejecutar código, sino que participa en el proceso de decisión; Atlas no solo muestra resultados, sino que anticipa intenciones. Ambos se convierten en espacios de negociación entre la voluntad humana y la lógica algorítmica.

El verdadero salto no radica en la inteligencia de los modelos, sino en la arquitectura de confianza que los rodea. Quien controle esos límites —el sandbox, los permisos, la auditoría— controlará también el tipo de autonomía posible.

Auditar la agencia, el nuevo oficio invisible

A medida que las tareas se automatizan, el trabajo humano se desplaza hacia la observación del agente: auditar qué hizo, por qué lo hizo y bajo qué criterio se convierte en la nueva competencia crítica.

No se trata solo de revisar código o logs, sino de interpretar decisiones: entender cómo el sistema eligió una fuente de datos o una librería. La confianza deja de ser un acto de fe y se convierte en un ejercicio de interpretación continua.

En cierto sentido, la IA no sustituye al trabajador, sino que lo transforma en auditor de autonomía. La eficacia aumenta, pero también la distancia entre acción y comprensión.

Autonomía en equilibrio, el pacto tácito del futuro del trabajo

Claude Code y Atlas no son solo lanzamientos: son ensayos de convivencia entre inteligencia y control. Representan dos extremos del mismo experimento: un agente que puede actuar, pero solo dentro de una jaula de permisos explícitos.

Lo decisivo no será quién logre el mejor modelo, sino quién defina la gramática social de la autonomía: qué se puede hacer sin pedir permiso, qué requiere confirmación y qué nunca debería delegarse.

Quizá el futuro del trabajo no dependa tanto de la potencia de la IA como de nuestra habilidad para diseñar pactos de agencia sostenibles. Ni sumisión ciega ni libertad absoluta: una tercera vía en la que el agente no obedece ni se emancipa, sino que negocia.

En esa tensión —la de un poder que necesita límites para ser confiable— se está escribiendo la próxima década de la inteligencia aplicada.