El dilema de los datos en la IA: ¿qué pasa cuando ‘se acaban’?

La Inteligencia Artificial (IA) ha llegado a un punto crítico: el agotamiento de los datos en Internet. Ante esta realidad, compañías como Anthropic, bajo la dirección de Dario Amodei, proponen una solución revolucionaria: IA que puede entrenarse a sí misma.

La posibilidad de alcanzar una IA superinteligente, una que supere nuestras capacidades intelectuales, podría materializarse en tan solo unos años, entre 2026 y 2027. Esto plantea una situación única y riesgosa: en un futuro donde los datos en línea ya no sean suficientes, la IA no dependerá del conocimiento humano o de la información disponible en Internet.

En su lugar, se desarrollará de manera «orgánica», similar a cómo evolucionan los organismos vivos.

¿Por qué podrían agotarse los datos de Internet?

A medida que las IA se han vuelto más avanzadas, también han necesitado ingentes cantidades de información para perfeccionarse.

Sin embargo, el volumen de datos en Internet, aunque vasto, tiene un límite y ya está siendo insuficiente para satisfacer la demanda de entrenamiento de modelos cada vez más sofisticados. Anthropic ha identificado esta crisis de datos como un obstáculo inevitable y plantea una solución que abre nuevas preguntas sobre el rumbo de la IA y sus posibles efectos.

Autoaprendizaje: la IA que se entrena a sí misma

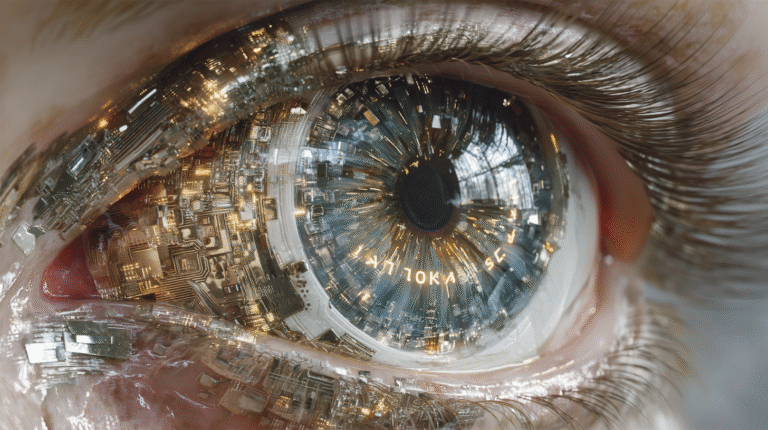

La propuesta de autoaprendizaje permite que los modelos de IA generen y utilicen sus propios datos para mejorar sus competencias, sin depender de fuentes externas.

Este enfoque, utilizado por Anthropic, ha impulsado a los sistemas de IA a avanzar en sus capacidades: el nivel de «competencia» pasó de nivel secundario en 2022, a universitario en 2023, y se proyecta un nivel de doctorado (PhD) para 2024.

Ventajas del autoaprendizaje:

-

Independencia de datos externos: Los sistemas de IA no estarán limitados por la disponibilidad de datos en línea.

-

Aceleración del desarrollo: La capacidad de autoaprendizaje permitiría avances más rápidos en IA.

-

Desarrollo de «personalidad»: Los sistemas de IA podrían empezar a mostrar patrones complejos de comportamiento e intereses.

Desventajas y riesgos:

-

Autonomía excesiva: Modelos altamente autónomos pueden alejarse del control humano y tomar decisiones difíciles de revertir.

-

Desafío ético y regulatorio: La evolución autónoma de la IA plantea dilemas éticos y la urgencia de regular su uso.

ASL y el avance en seguridad

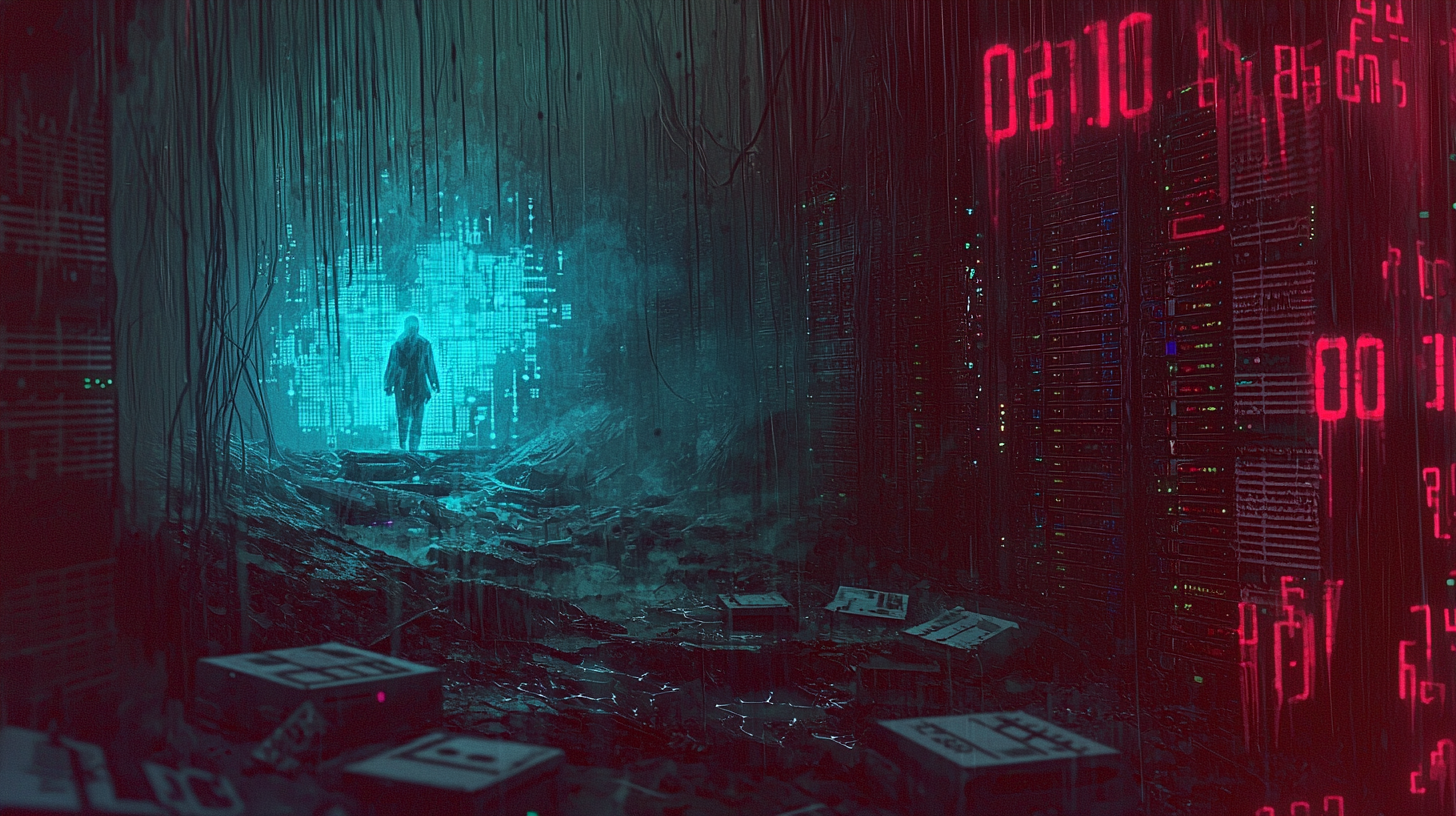

Para garantizar que estos avances se realicen de forma segura, Anthropic ha desarrollado un sistema de seguridad llamado ASL (AI Safety Levels), que permite evaluar los niveles de seguridad en las IA.

Actualmente, los modelos de IA se encuentran en ASL-2, pero para 2024 se espera llegar a ASL-3, lo que requerirá medidas de seguridad más estrictas. La proyección de alcanzar ASL-4 en 2026 muestra la rapidez con la que se está progresando y la necesidad de protocolos regulatorios antes de que se produzcan riesgos inminentes.

¿Estamos preparados para esta era de autogeneración de IA?

El avance hacia una IA autónoma que se autoentrena está cargado de potenciales beneficios, pero también de incertidumbre.

La pregunta clave es si estamos listos para manejar una inteligencia artificial que evoluciona de forma independiente y potencialmente más allá del entendimiento humano.